Nvidia (NVDA) presentó en su conferencia anual GTC una hoja de ruta que estima una oportunidad de ingresos de al menos $1 billón en chips de inteligencia artificial hacia 2027, duplicando la proyección de $500.000 millones que la compañía había comunicado en su último reporte de resultados. El foco estratégico de la empresa se desplazó hacia el mercado de inferencia, donde los sistemas de IA procesan consultas en tiempo real, un segmento de mayor competencia que el entrenamiento, donde Nvidia mantiene dominio casi absoluto. Para consolidar su posición, la compañía presentó una nueva arquitectura que divide el proceso en dos etapas: los chips Vera Rubin gestionarán la fase de «prefill», mientras que los procesadores de Groq —startup cuya tecnología Nvidia licenció por $17.000 millones en diciembre— manejarán la etapa de «decode».

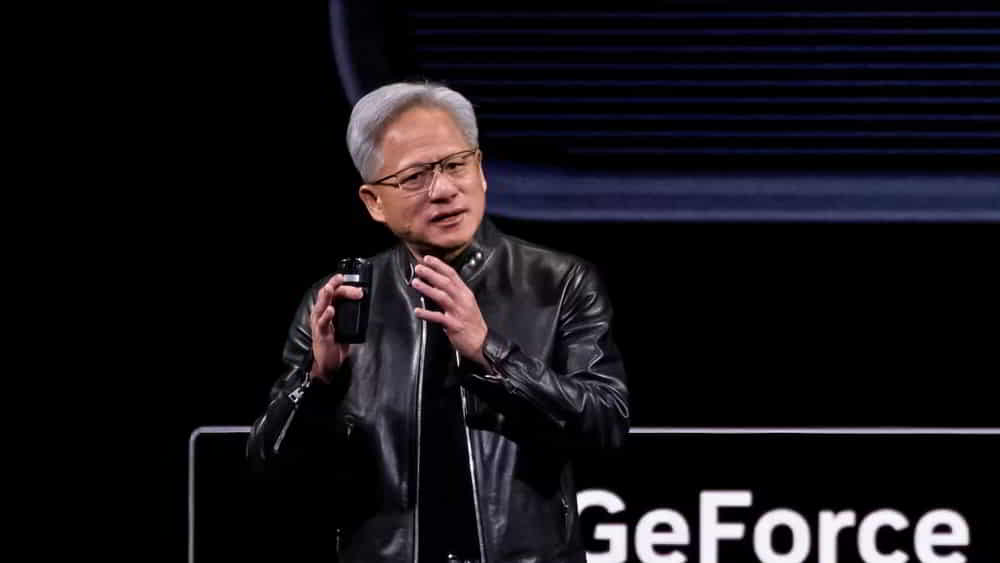

La conferencia también anticipó una nueva generación de chips denominada Feynman y profundizó en inversiones de $2.000 millones cada una en Lumentum y Coherent, compañías especializadas en comunicación óptica entre chips. El CEO Jensen Huang subrayó que la ventaja competitiva de Nvidia no reside únicamente en el hardware, sino en su ecosistema de software CUDA, que ancla a los desarrolladores y dificulta la migración hacia arquitecturas alternativas. La compañía mantiene presencia en prácticamente todos los proveedores de nube y sigue siendo el proveedor central para proyectos soberanos de IA en mercados como Arabia Saudita.

El desafío creciente para Nvidia proviene de sus propios clientes: empresas como Meta desarrollan chips propios orientados a inferencia, lo que podría reducir su dependencia del hardware de Nvidia en el mediano plazo. No obstante, la amplitud del ecosistema CUDA y la profundidad de las relaciones comerciales con hiperescaladores posicionan a la compañía como el proveedor dominante en la transición hacia una infraestructura de IA centrada en inferencia a escala. La proyección de un billón de dólares en ingresos refleja la expectativa de que la demanda de procesamiento de IA continuará expandiéndose de forma sostenida en los próximos años.